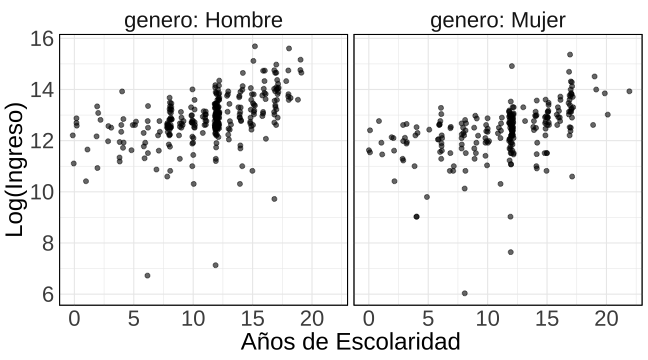

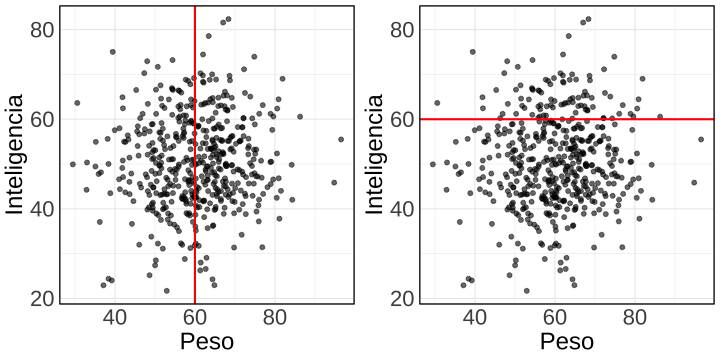

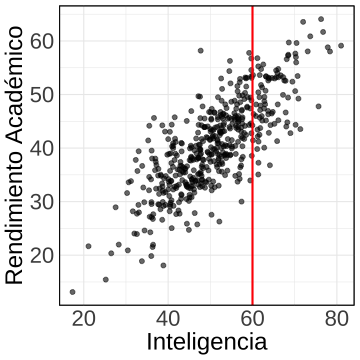

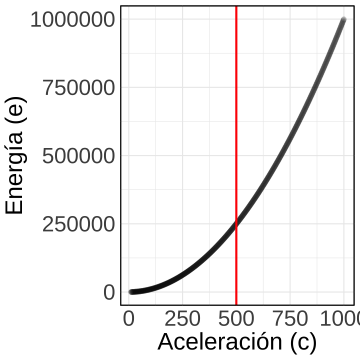

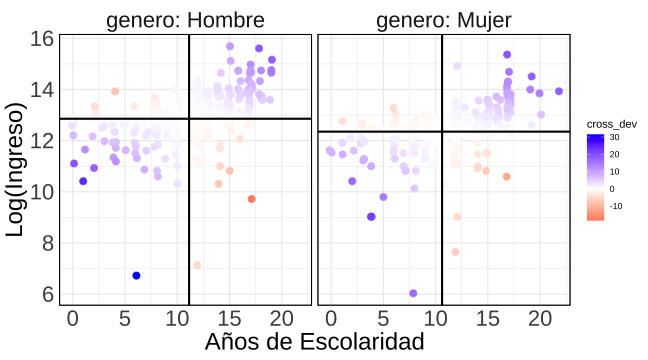

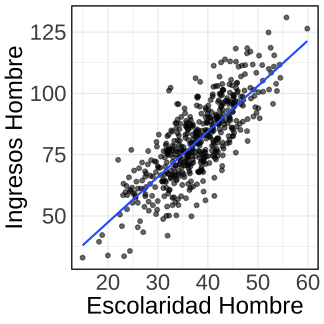

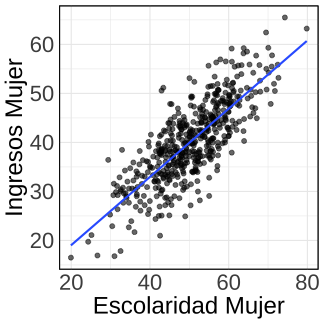

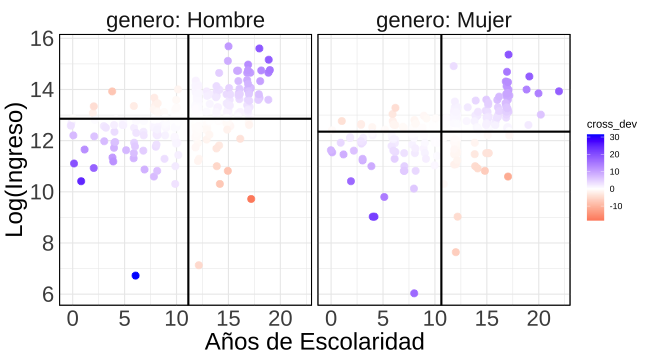

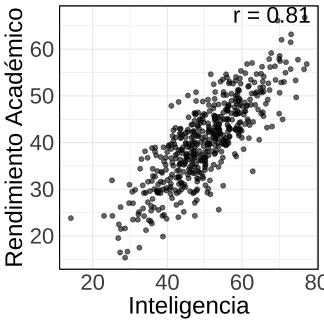

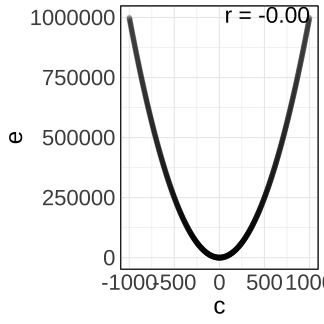

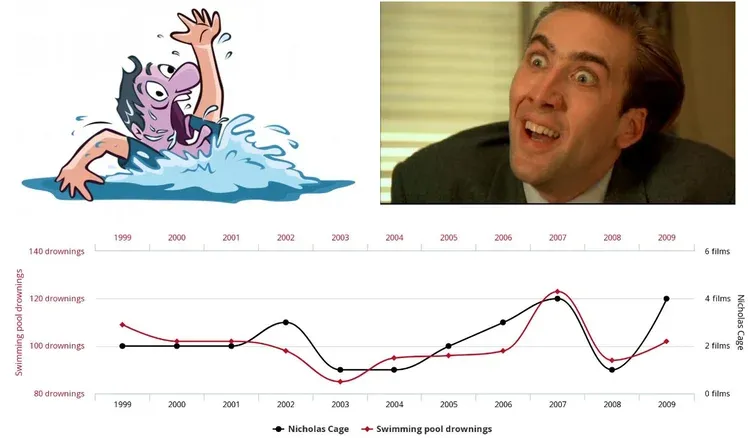

class: center, middle, inverse, title-slide .title[ # Probabilidad e Inferencia Estadística ] .subtitle[ ## Asociación entre variables continuas ] .author[ ### <br> Mauricio Bucca <br> <a href="https://github.com/mebucca">github.com/mebucca</a> <br> <a href="mailto:mebucca@uc.cl" class="email">mebucca@uc.cl</a> ] --- class: inverse, center, middle # Asociación entre variables continuas ## Correlación de Pearson --- ## Brechas de ingresos entre hombres y mujeres .pull-left[  ] .pull-right[  ] --- ## Retornos a la educación para hombres y mujeres .center[ <!-- --> ] <br> -- - ¿Existe una asociación entre los años de escolaridad y los ingresos? - ¿Varía esta asociación por género? --- ## Asociación entre variables continuas .bold[Independencia (no asociación)] .center[ <!-- --> ] -- - Dado un valor en una variable, los valores de la otra varían ampliamente. - Es decir: sabiendo algo sobre una variable no se nada sobre la otra. --- ## Asociación entre variables continuas .pull-left[ .bold[Asociación positiva] .center[ <!-- --> ] ] .pull-right[ .bold[Aociación perfecta (e=mc^2)] .center[ <!-- --> ] ] -- - Dado un valor en una variable, los valores de la otra variable varías poco (o nada). - Es decir: sabiendo algo sobre una variable se algo (o todo) sobre la otra. --- class: inverse, center, middle #Covarianza --- ##Covarianza <br> -- - Hasta ahora hemos trabajado principalmente con variables aleatorias independiente, `\(Y \perp X\)`. -- - Dos variable aleatorias son dependiente entre si `\(\mathbb{P}(Y \mid X ) \neq \mathbb{P}(Y)\)`, y viceversa. -- - Otra forma de persona la dependencia es en términos de co-variabilidad entre dos variables aleatorias. <br> <br> -- La .bold[covarianza] mide la dependencia (lineal*) entre dos variables aleatorias. Formalmente: .content-box-secondary[ `$$\color{white}{\mathbb{Cov}(X, Y) = \mathbb{E}[ \ (X - \mathbb{E}[X]) \ (Y - \mathbb{E}[Y]) \ ]}$$` ] <br> -- En promedio, ¿cuánto y cómo se desvía `\(X\)` respecto de su media, cuando `\(Y\)` se desvía de la suya? --- ##Covarianza <br> .center[ <!-- --> ] - .bold[Cov(esc,log-ingreso) | Hombre] = 1.8612011 - .bold[Cov(esc,log-ingreso) | Mujer] = 2.1777403 --- ##Interpretación de la covarianza <br> La covarianza se puede interpretar de la siguiente manera: <br> - .bold[Covarianza positiva]: X e Y tienden a aumentar o disminuir juntas. - .bold[Covarianza negativa]: X aumenta cuando Y disminuye y viceversa. - .bold[Covarianza cero]: No hay relación lineal. --- ##Propiedades de la covarianza <br> - .bold[Covarianza de variables independientes]- Si dos variables aleatorias `\(X\)` e `\(Y\)` son independientes, entonces `$$\mathbb{Cov}(X, Y) = 0$$` -- - .bold[Covarianza de variable perfectamente dependientes] (consigo misma) `$$\mathbb{Cov}(X, X) = \text{Var}(X)$$` -- - .bold[Covarianza con una Constante] `$$\mathbb{Cov}(X, a) = 0$$` -- - .bold[Aditividad] `$$\mathbb{Cov}(X + Y, Z) = \mathbb{Cov}(X, Z) + \mathbb{Cov}(Y, Z)$$` -- - .bold[Multiplicación por una constante] `$$\mathbb{Cov}(aX, Y) = a \cdot \mathbb{Cov}(X, Y)$$` --- ##Estimación de la covarianza <br> Podemos estimar la covianza a partir de datos muestrales usando la siguiente fórmula <br> `$$s_{XY} = \frac{\sum_{i=1}^{n} (X_i - \bar{X})(Y_i - \bar{Y})}{n-1}$$` <br> -- - `\(s_{XY}\)` es un estimador insesgado de `\(\mathbb{Cov}(X, Y)\)`. --- ## Problema de interpretación de la covariana - Supongamos que la asociación entre escolariadad e ingresos es la misma para hombres y para mujeres - Supongamos que el ingreso de los hombres es el doble que el de las mujeres: `\(Y_h = 2 \times Y_m\)` - Supongamos que la escolaridad de los hombres es un 75% que la de las mujeres:s: `\(E_h = 0.75 \times E_m\)` -- .pull-left[ .bold[Hombres] .center[ <!-- --> ] ] .pull-right[ .bold[Mujeres] .center[ <!-- --> ] ] --- ## Problema de interpretación de la covariana <br> -- - Si `\(Y_h = 2 \times Y_m \quad\)` y `\(\quad E_h = 0.75 \times E_m\)` <br> -- `$$\color{blue}{\mathbb{Cov}(E_h, Y_h)} = \mathbb{Cov}( 0.75 \times E_m, 2 \times Y_m) = \color{red}{0.75 \times 2} \times \color{blue}{\mathbb{Cov}(E_m, Y_m)}$$` <br> -- - .bold[Cov(esc,log-ingreso) | Hombre] = 90.1150216 - .bold[Cov(esc,log-ingreso) | Mujer] = 60.076681 <br><br> -- .bold[Problema de interpretabilidad:] La covarianza combina dos cosas: - La fuerza de la asociación entre las variables - La escala de dichas variables - Por tanto, el número obtenido no indica inequivocamente la fuerza de la asociación --- class: inverse, center, middle #Correlación de Pearson --- ##Correlación de Pearson - ¿Cómo podemos medir el grado de asociación entre dos variables, libre de sus escala? -- - .bold[Solución:] Estandarizar. En vez de calcular `\(\mathbb{Cov}(X, Y)\)` calculamos `\(\mathbb{Cov}(Z_X, Z_Y)\)`. Formalmente, <br> -- $$ `\begin{align} \mathbb{Cov}(Z_X, Z_Y) &= \mathbb{E}[ \ (Z_X - \mathbb{E}[Z_X]) \ (Z_Y - \mathbb{E}[Z_Y]) \ ] \\ \\ &= \mathbb{E}[ \ Z_X \ Z_Y \ ] \\ \\ &= \mathbb{E}\Bigg[ \ \frac{(X - \mathbb{E}[X])}{\sqrt{\mathbb{Var}[X]}} \ \frac{(Y - \mathbb{E}[Y])}{\sqrt{\mathbb{Var}[Y]}} \ \Bigg] \\ \\ &= \frac{\mathbb{Cov}(X, Y)}{\sqrt{\mathbb{Var}[X]}\sqrt{\mathbb{Var}[Y]}} \end{align}` $$ --- ##Correlación de Pearson <br> Si $$ `\begin{align} \mathbb{Cov}(Z_X, Z_Y) = \frac{\mathbb{Cov}(X, Y)}{\sqrt{\mathbb{Var}[X]}\sqrt{\mathbb{Var}[Y]}} \end{align}` $$ <br> <br> -- El .bold[Coeficiente de Correlación de Pearson] se define como: .content-box-secondary[ `$$\color{white}{\rho_{XY}: \mathbb{Corr}(X, Y) = \frac{\mathbb{Cov}(X, Y)}{\sigma_X \sigma_Y}}$$` ] --- ## Interpretación del Coeficiente de Correlación <br> <br> -- - `\(\rho \in [-1,1]\)`: varía entre -1 y +1 y mide la fuerza y dirección de una relación lineal entre dos variables. <br> -- - `\(\rho > 0\)` indica una relación positiva entre las variables; a medida que una aumenta, la otra tiende a aumentar también. Un valor cercano a +1 implica una fuerte correlación positiva. <br> -- - `\(\rho < 0\)` señala una relación negativa; cuando una variable aumenta, la otra tiende a disminuir. Un valor cercano a -1 indica una fuerte correlación negativa. <br> -- - `\(\rho = 0\)` indica ugiere que no hay asociación lineal entre las variables. Los valores que se acercan a cero indican una débil o nula correlación lineal. --- ## Estimación del Coeficiente de Correlación Podemos estimar el coeficiente de correlación a partir de datos muestrales utilizando la siguiente fórmula: <br><br> `$$r_{XY} = \frac{\sum_{i=1}^{n} (X_i - \bar{X})(Y_i - \bar{Y})}{\sqrt{\sum_{i=1}^{n} (X_i - \bar{X})^2 \sum_{i=1}^{n} (Y_i - \bar{Y})^2}}$$` <br> donde - `\(r_{XY}\)` es el coeficiente de correlación muestral entre las variables X e Y. - `\(\bar{X}\)` y `\(\bar{Y}\)` son las medias de las muestras de X e Y, respectivamente. - `\(n\)` es el número de observaciones en las muestras. --- ##Correlación de Pearson <br> .center[ <!-- --> ] - .bold[Corr(esc,log-ingreso) | Hombre] = 0.4682563 - .bold[Corr(esc,log-ingreso) | Mujer] = 0.4653663 --- ##Correlación Lineal de Pearson .bold[Importante]: La covarianza y correlación miden el grande de .bold[asociación lineal]. -- - Una correlación baja o nula no indica necesariamente falta de asociación. -- .pull-left[ .bold[Asociación positiva] .center[ <!-- --> ] ] .pull-right[ .bold[Asociación no lineal perfecta ] .center[ <!-- --> ] ] --- ## DANGER: CORRELATIONS IS NOT CAUSATION! <br> .center[  ] --- class: inverse, center, middle ##The End. Gracias! <br> Mauricio Bucca <br> https://mebucca.github.io/ <br> github.com/mebucca