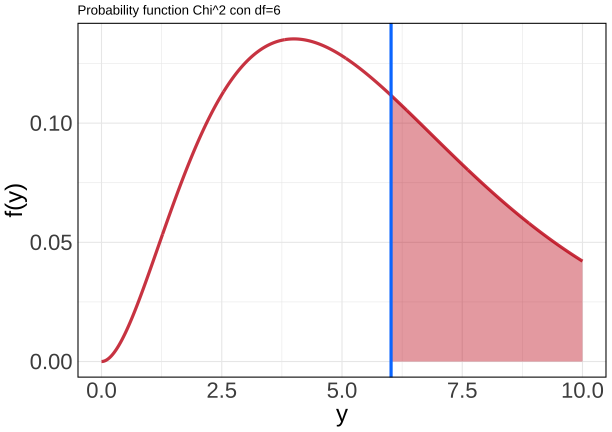

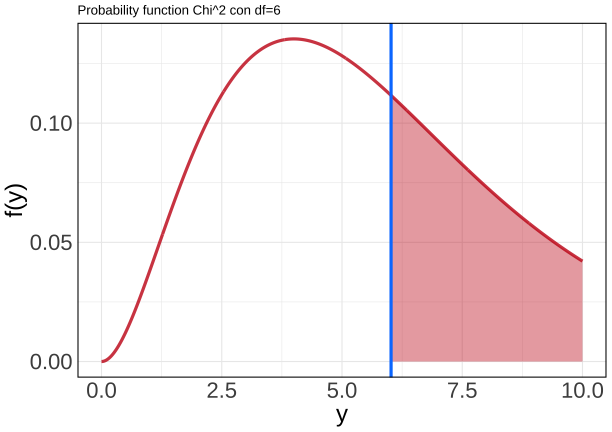

class: center, middle, inverse, title-slide .title[ # Probabilidad e Inferencia Estadística ] .subtitle[ ## Asociación entre variables categóricas ] .author[ ### <br> Mauricio Bucca <br> <a href="https://github.com/mebucca">github.com/mebucca</a> <br> <a href="mailto:mebucca@uc.cl" class="email">mebucca@uc.cl</a> ] --- class: inverse, center, middle ## Test `\(\chi^{2}\)` de indepencia estadística --- ### Test `\(\chi^{2}\)` de indepencia estadística ``` r library("carData") data("Chile") datos_chile <- Chile datos_chile <- datos_chile %>% filter(vote == "Y" | vote=="N") %>% mutate(vote = factor(vote)) ctable <- datos_chile %>% with(table(income,vote)) ``` <br> Primer paso, testear que exista _algo_ de asociación: ¿son estas tablas _suficientemente distintas_? .pull-left[ .bold[Frecuencias observadas] ``` ## vote ## income N Y ## 2500 47 55 ## 7500 143 160 ## 15000 245 240 ## 35000 269 228 ## 75000 98 92 ## 125000 38 31 ## 200000 29 35 ``` ] -- .pull-right[ .bold[Frecuencias esperadas bajo independencia] ``` ## N Y ## 2500 51.83509 50.16491 ## 7500 153.98070 149.01930 ## 15000 246.47076 238.52924 ## 35000 252.56901 244.43099 ## 75000 96.55556 93.44444 ## 125000 35.06491 33.93509 ## 200000 32.52398 31.47602 ``` ] <br> Donde cada frecuencia esperada bajo independencia está dada por: `\(\tilde{n}_{ij} = n \times \hat{p}_{i+} \times \hat{p}_{+j}\)` --- ### Test `\(\chi^{2}\)` de indepencia estadística .pull-left[ .bold[Frecuencias observadas] ``` ## vote ## income N Y ## 2500 47 55 ## 7500 143 160 ## 15000 245 240 ## 35000 269 228 ## 75000 98 92 ## 125000 38 31 ## 200000 29 35 ``` ] -- .pull-right[ .bold[Frecuencias esperadas bajo independencia] ``` ## N Y ## 2500 51.83509 50.16491 ## 7500 153.98070 149.01930 ## 15000 246.47076 238.52924 ## 35000 252.56901 244.43099 ## 75000 96.55556 93.44444 ## 125000 35.06491 33.93509 ## 200000 32.52398 31.47602 ``` ] -- - El test Pearson `\(\chi^{2}\)` (**t**) mide el grado asociación en la tabla de la siguiente manera: .content-box-secondary[ `$$\color{white}{t =\sum_{\text{all k: } i,j} \frac{(n_{ij} - \tilde{n}_{ij})^{2}}{\tilde{n}_{ij}}}$$` ] .bold[Un valor alto de `\(t\)` sugiere que las variables no son independientes.] -- Pero, ¿cuánto es "alto"? --- ### Test `\(\chi^{2}\)` de indepencia estadística .bold[Nota:] - Si `\(Z_{1}, \dots , Z_{k}\)` son variables independientes y cada `\(Z \sim \text{Normal}(0,1)\)`, - Entonces la variable `\(Y = \sum_{k} Z^{2} \sim \chi^{2}_{k}\)`. `\(Y\)` distribuye `\(\chi^{2}\)` con `\(k\)` grados de libertad. <br> -- .bold[Heuristica:] - `\(t =\sum_{\text{all k: } i,j} \frac{(n_{ij} - \tilde{n}_{ij})^{2}}{\tilde{n}_{ij}}\)` - Si no hay asociación entre las variables ( `\(H_{0}\)` ) entonces: `\(t =\sum_{\text{all k: } i,j} \frac{(\text{algo cercano a cero})^{2}}{\tilde{n}_{ij}}\)` <br> -- Pearson demostró que si `\(H_{0}\)` es verdadera, entonces: .content-box-secondary[ `$$\color{white}{t \sim \chi_{df}^{2}, \quad \text{ donde } \quad df= (I-1)(J-1)}$$` ] Esto le da el nombre al test `\(\chi^{2}\)`, pero no confundir con la distribución `\(\chi^{2}\)`. --- ### Test `\(\chi^{2}\)` de indepencia estadística <br> .bold[p-value]: .content-box-secondary[ `$$\color{white}{\mathbb{P}(t > \hat{t} \mid H_{0})}$$` ] equivalente a: -- .content-box-secondary[ `$$\color{white}{\mathbb{P}(\chi_{df}^{2} > \hat{t})}$$` ] <style type="text/css"> .pull-right ~ * { clear: unset; } .pull-right + * { clear: both; } </style> --- ### Test `\(\chi^{2}\)` de indepencia estadística .bold[(Observado-Esperado)^2/Espetado:] .center[ ``` r (((ctable - ctable_independence)^(2))/ctable_independence) %>% print() ``` ``` ## vote ## income N Y ## 2500 0.451008656 0.466024402 ## 7500 0.783057939 0.809128834 ## 15000 0.008776439 0.009068639 ## 35000 1.068925967 1.104514465 ## 75000 0.021608490 0.022327917 ## 125000 0.245679780 0.253859368 ## 200000 0.381823271 0.394535580 ``` ] <br> -- .bold[Test Chi-2 : ∑ (Observado-Esperado)^2/Espetado] ``` ## [1] 6.02034 ``` --- ### Test `\(\chi^{2}\)` de indepencia estadística .pull-left[ <!-- --> .bold[Para ser claros:] Si la hipótesis de independencia ( `\(H_{0}\)` ) es cierta, nuestro test `\(t\)` distribuye `\(\chi^{2}\)` con `\(df= (I-1)(J-1)=6\)` ] -- .pull-right[ .bold[p-value] `$$\mathbb{P}(\chi_{df=6}^{2} \geq \hat{t} )$$` ``` r 1- pchisq(our_chi2,df=6) ``` ``` ## [1] 0.4209155 ``` ] --- ### Test `\(\chi^{2}\)` de indepencia estadística .pull-left[ <!-- --> .bold[Para ser claros:] Si la hipótesis de independencia ( `\(H_{0}\)` ) es cierta, nuestro test `\(t\)` distribuye `\(\chi^{2}\)` con `\(df= (I-1)(J-1)=6\)` ] .pull-right[ .bold[p-value] `$$\mathbb{P}(\chi_{df=6}^{2} \geq \hat{t})$$` ``` r 1- pchisq(our_chi2,df=6) ``` ``` ## [1] 0.4209155 ``` ``` r # Versión automática chisq.test(ctable,correct = FALSE) ``` ``` ## ## Pearson's Chi-squared test ## ## data: ctable ## X-squared = 6.0203, df = 6, p-value = 0.4209 ``` ] -- .bold[Conclusión]: el valor obtenido en nuestro test no es un valor demasiado improbable bajo independencia. No tenemos evidencia fuerte para sostener que ambas variables están asociadas. --- class: inverse, center, middle ##Hasta la próxima clase. Gracias! <br> Mauricio Bucca <br> https://mebucca.github.io/ <br> github.com/mebucca